Edge AI : quand l’intelligence artificielle s’exécute au plus près de la donnée

L’Edge AI désigne l’exécution de modèles d’intelligence artificielle directement sur des appareils ou micro-serveurs proches de la source de données. Une approche qui réduit la latence, améliore la confidentialité et ouvre la porte à de nouveaux usages, bien au-delà de ce que permet le cloud seul.

Publié le 10 déc. 2025 Lecture 6 min.

Le nombre d’objets connectés explose : capteurs, caméras, robots, appareils mobiles… Tous produisent des volumes de données gigantesques. Pendant longtemps, la stratégie dominante consistait à transmettre ces données vers des serveurs infonuagiques (cloud) pour les analyser. Aujourd’hui, ce modèle atteint ses limites : délais trop longs pour les applications en temps réel, coûts de transmission élevés, risque de saturation des réseaux, enjeux de confidentialité. D’où l’émergence d’une autre manière de faire : rapprocher l’intelligence artificielle des données elles-mêmes.

Qu’est-ce que l’Edge AI ?

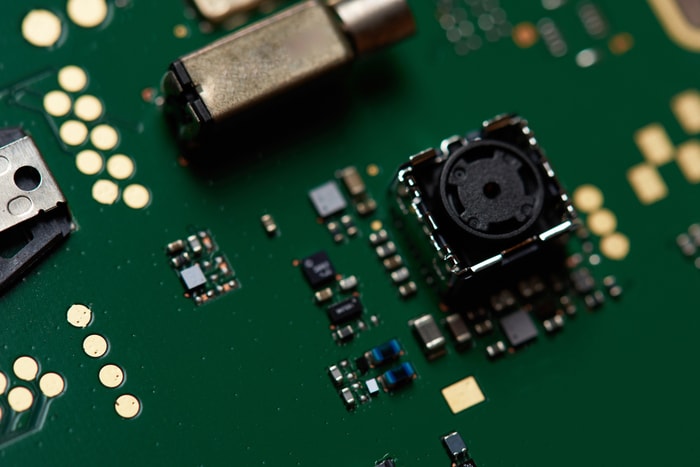

L’Edge AI (ou IA en périphérie du réseau) consiste à exécuter des modèles optimisés d’IA directement sur des appareils situés à la périphérie du réseau, c’est-à-dire au plus près de l’endroit où les données sont produites : capteurs, robots, téléphones, microcontrôleurs, passerelles 5G, caméras, petits serveurs industriels etc.

L’idée est d’analyser localement plutôt que d’envoyer tout vers le cloud.

Un système Edge AI suit généralement un pipeline simple :

Un capteur capte une donnée brute (image, vibration, son, température, position, signal biologique etc.)

Un mini-modèle d’IA analyse localement cette donnée

Une décision ou une action est prise immédiatement (détection d’un problème, alerte, commande à un robot, ajustement automatique etc.).

Pourquoi déplacer l’IA à la périphérie ?

Le choix de déplacer le calcul vers la périphérie présente plusieurs avantages majeurs :

Une latence minimale

Pour certains usages, quelques millisecondes font la différence : freinage d’un véhicule autonome, arrêt automatique d’une machine, détection d’un intrus, diagnostic en temps réel. L’approche Edge AI évite les allers-retours vers un serveur distant et garantit une réactivité quasi instantanée.

Réduction de la bande passante

Les flux vidéos ou les mesures d’un capteur génèrent énormément de données. Le traitement local minimise la quantité de données qui doivent être envoyées sur le réseau. Cela préserve la bande passante, réduit les coûts d'infrastructure et de transfert de données vers le cloud, et permet aux applications de fonctionner de manière fiable même dans des zones à faible connectivité.

Plus de confidentialité et de sécurité

Lorsque les données sont sensibles, le système Edge AI offre une plus grande confidentialité. Les images de la caméra de sécurité du domicile, les données d'un moniteur de santé portatif ou encore les informations confidentielles d'une usine restent sur l'appareil. Cela réduit drastiquement les risques liés à la transmission et au stockage de données personnelles ou sensibles sur des serveurs tiers.

Comment ça fonctionne concrètement ?

Faire fonctionner de l’IA en périphérie du réseau demande de concilier deux mondes qui, traditionnellement, ne sont pas vraiment compatibles. D’un côté, la puissance computationnelle nécessaire à l’IA et de l’autre les contraintes des appareils en périphérie (mémoire limitée, faible autonomie énergétique, capacité de calcul réduite, etc.). Pour y parvenir, plusieurs stratégies sont utilisées pour consommer moins d’énergie et rendre le modèle d’IA compatible avec le matériel embarqué :

Quantization : diminution de la précision du signal numérique pour alléger les calculs et réduire la mémoire utilisée

Pruning : suppression des paramètres les moins utiles dans un modèle afin de réduire sa taille et accélérer son exécution

Distillation : transfert des connaissances d’un grand modèle vers un modèle plus léger afin de conserver les performances essentielles tout en réduisant la taille, la consommation d’énergie et les besoins en calcul

Matériel spécialisé pour l’Edge AI : processeurs optimisés pour exécuter des milliards d’opérations par seconde, malgré les contraintes d’encombrement, de chaleur et consommation d’énergie

Dans la majorité des cas, l’entraînement et la mise à jour des modèles s’effectuent dans le cloud, tandis que l’inférence, soit l’analyse d’une donnée et la prise de décision en temps réel, est réalisée localement. Cette architecture hybride permet de combiner le meilleur des deux mondes : la puissance du cloud et la rapidité, la proximité et l’autonomie du local.

Une variante poussée de cette approche est le système TinyML (Tiny Machine Learning). Il permet d’exécuter des modèles d’IA sur des microcontrôleurs ultra-contraints (souvent moins de 1 Mo de mémoire et quelques milliwatts de puissance). Les stratégies mentionnées précédemment étant beaucoup plus contraignantes, TinyML permet de réaliser l’inférence locale sur des appareils minuscules, sans processeur et sans connexion réseau.

Applications concrètes du Edge AI

Industrie

Analyse vibratoire en continu pour anticiper une panne, contrôle qualité automatisé directement sur la chaîne de production, ajustements autonomes d’équipements.

Transports

Gestion intelligente des feux de circulation, analyse vidéo routière en temps réel, aide à la conduite ou détection d’obstacles sans dépendance au réseau.

Santé connectée

Montres et dispositifs médicaux capables de détecter des anomalies cardiaques en local et d’alerter immédiatement, sans transmettre toutes les données brutes.

Bâtiments intelligents

Optimisation de l’énergie, détection de présence, sécurité locale basée sur l’intelligence artificielle embarquée.

Les défis restent nombreux

Même si l’Edge AI progresse rapidement, plusieurs défis techniques freinent encore son déploiement à grande échelle.

L’hétérogénéité des appareils, chacun ayant sa propre puissance, sa mémoire et ses capacités, complique la compatibilité des modèles, les tests et les mises à jour.

Les contraintes énergétiques constituent un autre obstacle majeur. De nombreux appareils fonctionnent sur batterie ou dans des environnements où l’alimentation est limitée, ce qui impose des modèles extrêmement optimisés pour préserver l’autonomie et éviter la surchauffe.

La maintenance et la mise à l’échelle posent également problème. Mettre à jour des milliers d’appareils répartis sur un site industriel, dans une ville ou dans un réseau logistique requiert des outils capables de synchroniser les modèles, de vérifier leur fonctionnement tout en évitant les interruptions de service.

Enfin, la sécurité demeure un enjeu sensible. Les appareils edge sont souvent physiquement accessibles et donc exposés au vandalisme, aux manipulations ou aux intrusions. Ils doivent protéger les données locales tout en restant robustes face aux attaques réseau. La coordination entre un grand nombre d’appareils distribués ajoute une couche de complexité supplémentaire.

Malgré ces défis, l’Edge AI continue de progresser rapidement. Les modèles deviennent plus légers et plus efficaces, ce qui permet d’exécuter l’IA sur des appareils toujours plus compacts et économes. Les dispositifs en périphérie commencent aussi à mieux collaborer, en partageant leurs analyses et en se répartissant les tâches pour renforcer la fiabilité des systèmes. L’apprentissage local progresse et permet désormais à certains appareils d’ajuster leur modèle directement sur le terrain, tout en préservant la confidentialité. L’arrivée de la 5G (et demain de la 6G) transforme le réseau en véritable plateforme Edge AI. L’ensemble de ces avancées ouvre la voie à des systèmes plus autonomes, plus réactifs et mieux adaptés aux besoins du terrain.

Sources :

Heydari, S., & Mahmoud, Q. H. (2025). Tiny Machine Learning and On-Device Inference: A Survey of Applications, Challenges, and Future Directions. Sensors.

Alajlan, N. N., & Ibrahim, D. M. (2022). TinyML: Enabling of Inference Deep Learning Models on Ultra-Low-Power IoT Edge Devices for AI Applications. Micromachines.

Gill, S. S. et al. (2024). Edge AI: A Taxonomy, Systematic Review and Future Directions. Cluster Computing.

Zhou, Z. et al. (2019). Edge Intelligence: Paving the Last Mile of Artificial Intelligence with Edge Computing. Proceedings of the IEEE